AI act : Exigences techniques, Informations fournies et Documentation technique

Le règlement relatif aux intelligences artificielles définit des exigences applicables aux IA à haut risque, elles visent les produits et les informations fournies. Les preuves du respect des exigences sont compilées par le fournisseur d’IA dans une documentation technique.

Ci-dessous, sont repris :

- La liste des exigences techniques sur les IA à haut risque

- La liste des exigences relatives aux instructions d’utilisation

- Le contenu attendu de la documentation technique

- Portée du règlement : IA visées, exclues et à haut risque

- Objectifs et moyens du règlement IA

- Obligations des fournisseurs et déployeurs d’IA

- Exigences pour les IA à haut risque

- Focus : IA dispositifs médicaux, PME/Startups et environnement

Le dossier se base sur la proposition de règlement 2021/0106(COD) et la proposition de modification de juin 2023. Les travaux sont en cours, les exigences sont susceptibles d’évoluer.

Exigences techniques

Exactitude, robustesse, (cyber)sécurité

Les systèmes d’IA à haut risque doivent avoir un niveau approprié de précision, de robustesse, de sécurité et de cybersécurité. Le respect de ces exigences est soumis à la mise en œuvre de mesures conformes à l’état de la technique.

Les systèmes d’IA à haut risque font preuve de résilience en cas d’erreurs, de défaillances ou d’incohérences.

Des solutions techniques redondantes garantissent la robustesse.

Les systèmes d’IA à haut risque qui continuent leur apprentissage après leur mise sur le marché ou leur mise en service sont développés de telle sorte que les éventuels biais et manipulations des données d’apprentissage soient atténués.

Les systèmes d’IA à haut risque résistent aux tentatives de modification par des tiers non autorisés.

Contrôle humain

Une interface homme machine est conçue pour permettre le contrôle humain de l’IA, avant et après la mise sur le marché.

Ce contrôle humain permet de mesurer l’efficacité de l’IA, d’avoir conscience des éventuelles tendances, des biais, d’interpréter les données de sorties, de décider d’utiliser ou non l’IA, d’interrompre son fonctionnement…

Génération automatique de journaux

Les systèmes d’IA à haut risques incluent des fonctions d’enregistrements automatiques d’événements (journaux) relatifs aux dysfonctionnements du système.

Exigences spécifiques de transparence

Le règlement a des exigences de transparence propres à certaines IA :

- IA destinés à interagir avec des personnes (informent qu’elles interagissent avec un système d’IA).

- IA de reconnaissance des émotions ou de catégorisation biométrique (informent du fonctionnement du système).

- IA qui génère ou manipule des images ou des contenus audio ou vidéo présentant une ressemblance avec des personnes, des objets, des lieux ou d’autres entités ou événements existants et pouvant être perçus à tort comme authentiques ou véridiques : les « hypertrucage » (précisent que les contenus ont été générés ou manipulés artificiellement).

Protection de l’environnement

Les systèmes d’IA à haut risque intègrent des fonctionnalités d’enregistrement de la consommation d’énergie, de mesure de l’utilisation des ressources et de l’incidence environnementale pendant toutes les étapes du cycle de vie.

Informations fournies aux utilisateurs

Les informations fournies doivent permettre à l’utilisateur de comprendre le fonctionnement de l’IA et ses limites.

Les informations fournies incluent : les capacités, limite et performances de l’IA ; les informations relatives à l’exactitude, la robustesse, les mesures de cybersécurité, les référence aux tests de validation, la liste des situations dangereuses identifiées, les limites et performances selon les profils d’utilisateurs, des explications sur le fonctionnement de l’IA, la liste des mesures de contrôle humain implémentées, les mesures de maintenance, de suivi…

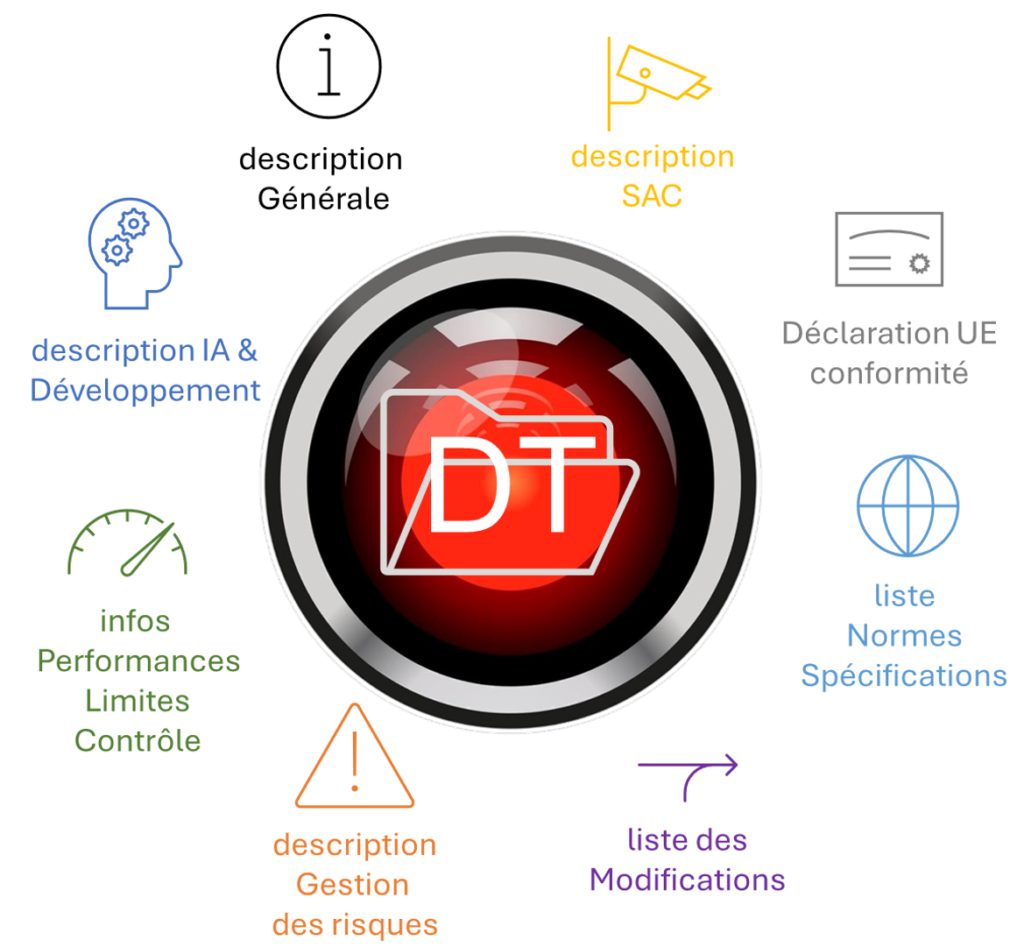

Documentation technique

La documentation technique permet de démontrer le respect des exigences règlementaires pour les IA à haut risque, elle inclut :

- Une description générale du système d’IA, notamment : destination, nature des données susceptibles d’être traitées, catégories de personnes susceptibles d’être concernées ou visées ; interaction avec d’autre matériel informatique, description de l’interface des déployeurs; instructions détaillées et aisément intelligibles pour interpréter les résultats du système d’IA ; exemples de scénarios pour lesquels le système ne devrait pas être utilisé…

- Une description détaillée des éléments du système d’IA et du processus de développement, notamment : méthodes et étapes pour le développement, recours à des systèmes ou outils pré-entraînés fournis par des tiers ; description de l’architecture, des spécifications de conception, des algorithmes et des structures des données ; principaux choix de conception ; exigences relatives aux données ; manière dont les données ont été obtenues et sélectionnées ; procédures d’étiquetage ; méthodes de nettoyage des données ; évaluation des mesures de contrôle humain ; procédures de validation et de test utilisées ; mesures de cybersécurité…

- Les informations détaillées sur la surveillance, le fonctionnement et le contrôle du système d’IA, en particulier en ce qui concerne les capacités et les limites du système sur le plan des performances, y compris le degré d’exactitude ; la description de l’adéquation des paramètres de performance au système d’IA ; les informations sur la consommation d’énergie…

- Une description détaillée du système de gestion des risques.

- Une description de toute modification éventuelle pertinente apportée par les fournisseurs au système.

- La Liste des normes harmonisées, autres normes pertinentes et spécifications communes appliquées.

- Une copie de la déclaration UE de conformité.

- Une description détaillée du système de surveillance après commercialisation.